Source

-

from U. of Washington good video!

Takeaway

-

Physics 最重要的是 symmetry, conservation law, invariance 如何體現在 AI/ML!!

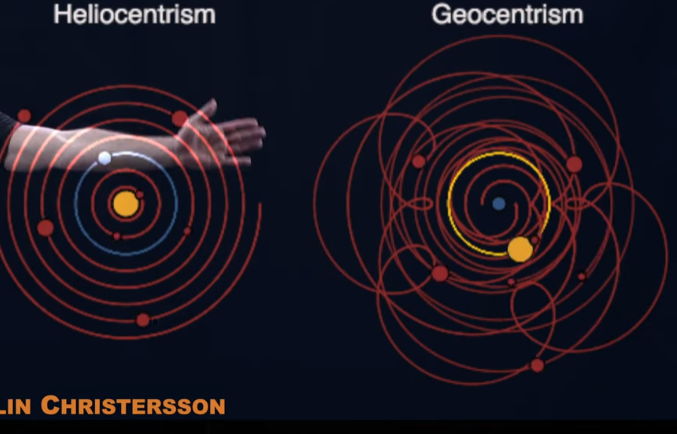

- Astrology vs. Astronomy

- Alchemy vs. Chemistry

-

Parsimony!

-

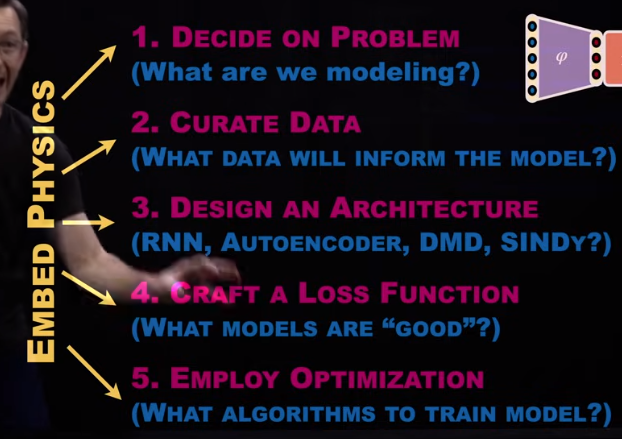

最重要是學習如何 embed prior knowledge to ML/AI

-

如何滿足 constraint? (例如 token translation 問題?)

-

使用 loss function, NOT a good way 因爲不會是 0

-

explicitly 使用 。。。。 TBD

-

-

如何減少 error?

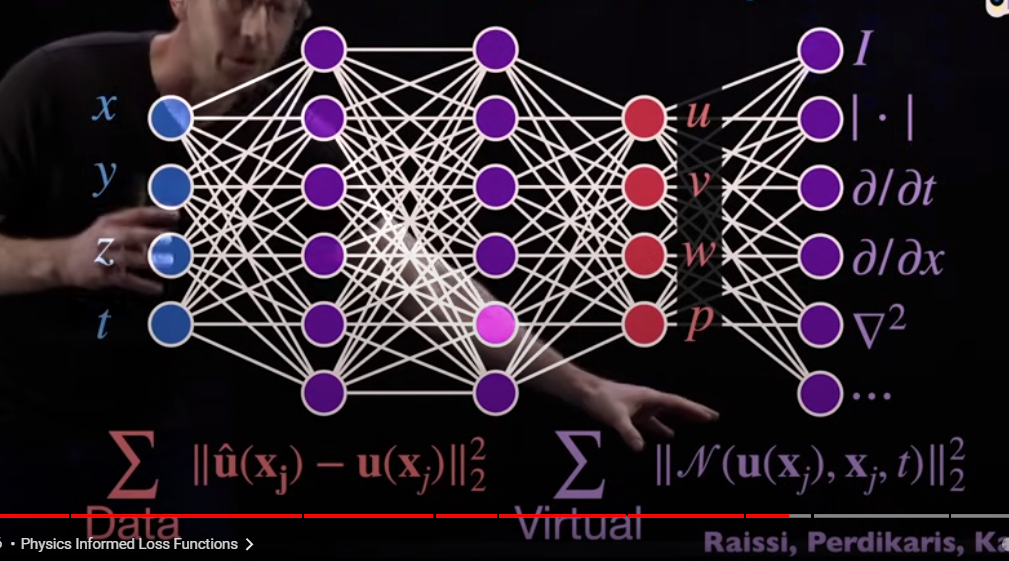

- 加上 extra physic loss function in training!! 特別是 physic quantity 都是可微分的!!!!!

開場

- Physics 也是一種 (differentiable) optimization.

- AI/ML 是 optimization

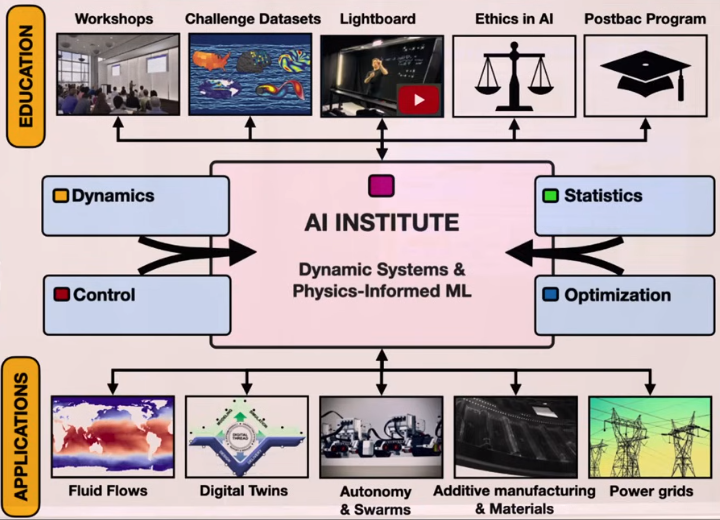

Physics to enforce ML/AI.

反之 use AI/ML to discover new physics

1 | |

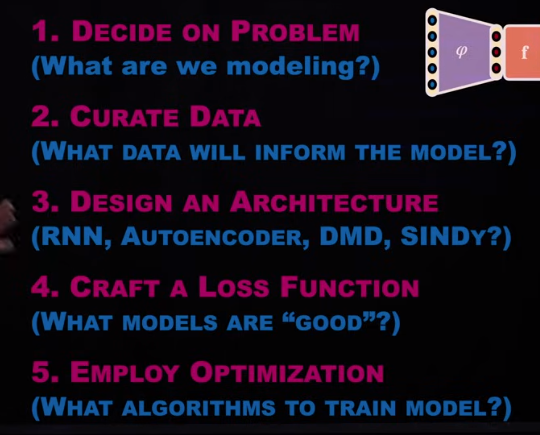

煉丹五部曲

加上 Physics!

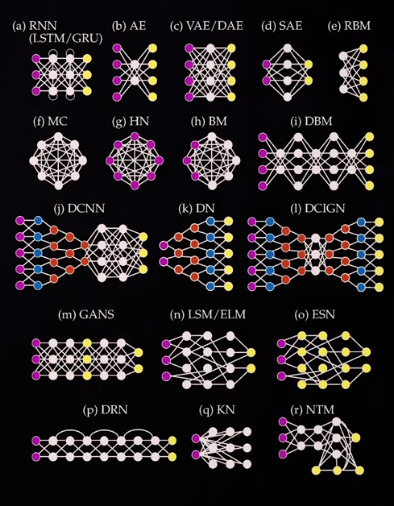

預備知識

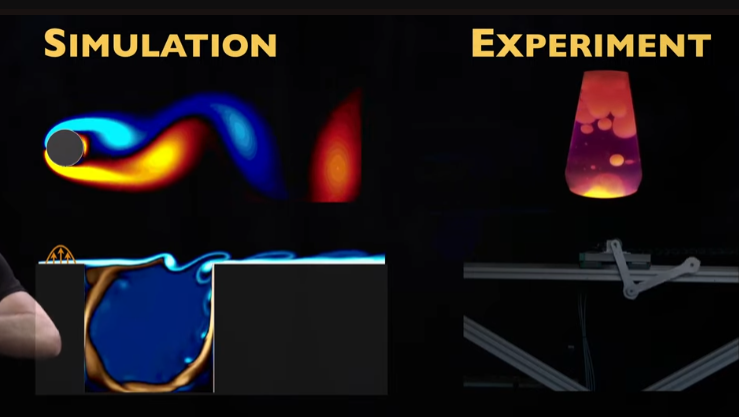

Data Collection (Huge advantage using physical knowledge 可以大幅減少 data!!)

-

use symmetry (圖1)

-

use right coordinate (圖 2)

-

use Fourier transform … (可以視爲 new coordinate system)

-

Simulation (slow, rich in spatial) or experiment (fast, good for temporal) (圖 3)

-

Data generalization 需要 滿足 physics (symmetry, conservation), and parsimony!

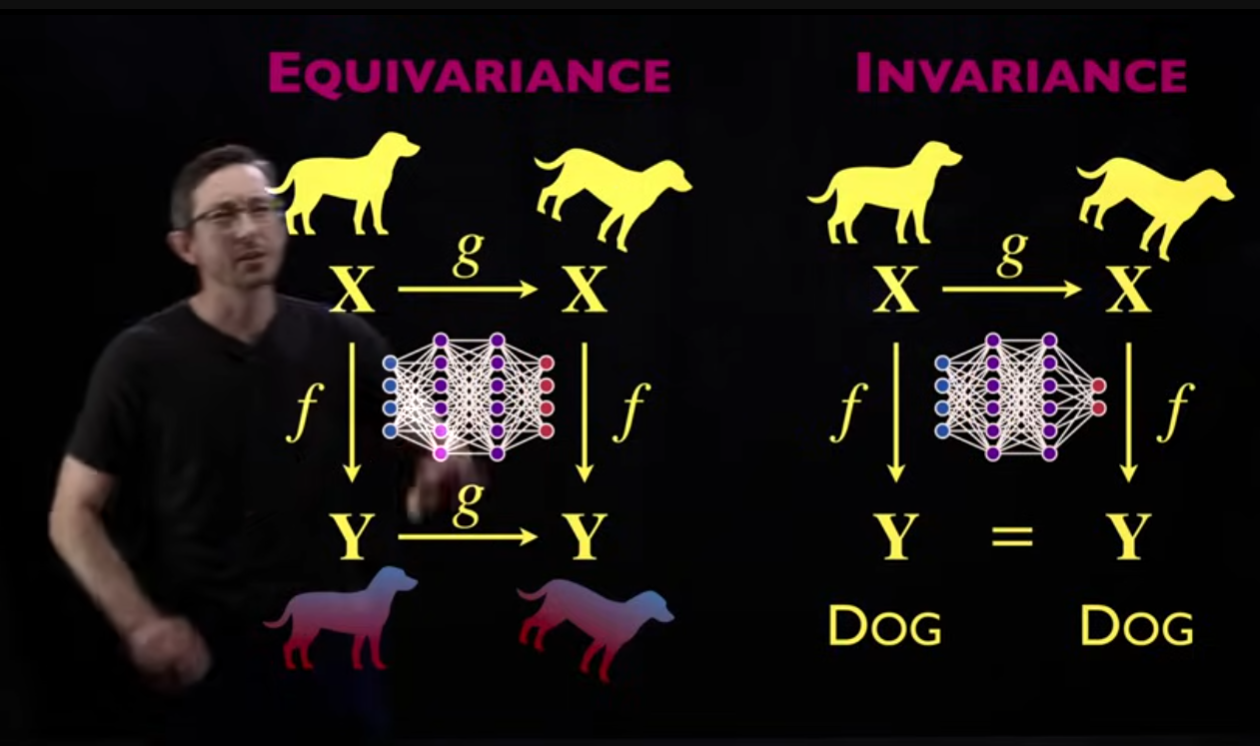

Symmetry, Invariance, Equivariance

常見的對稱性。

三種常見方法使用對稱性

-

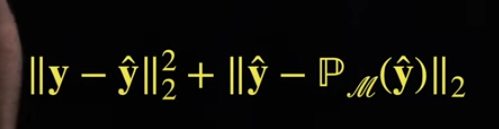

Promoting 對稱性:加上 loss function. M 是 manifold. 第二項是 y_hat 和 manifold 的距離要 minimize.

-

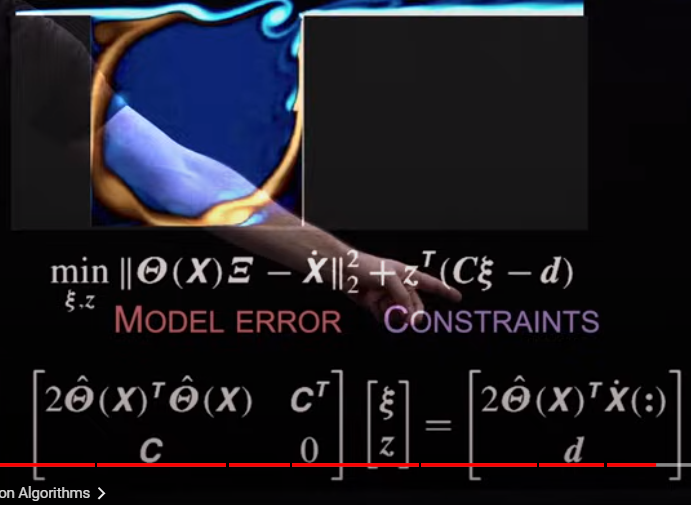

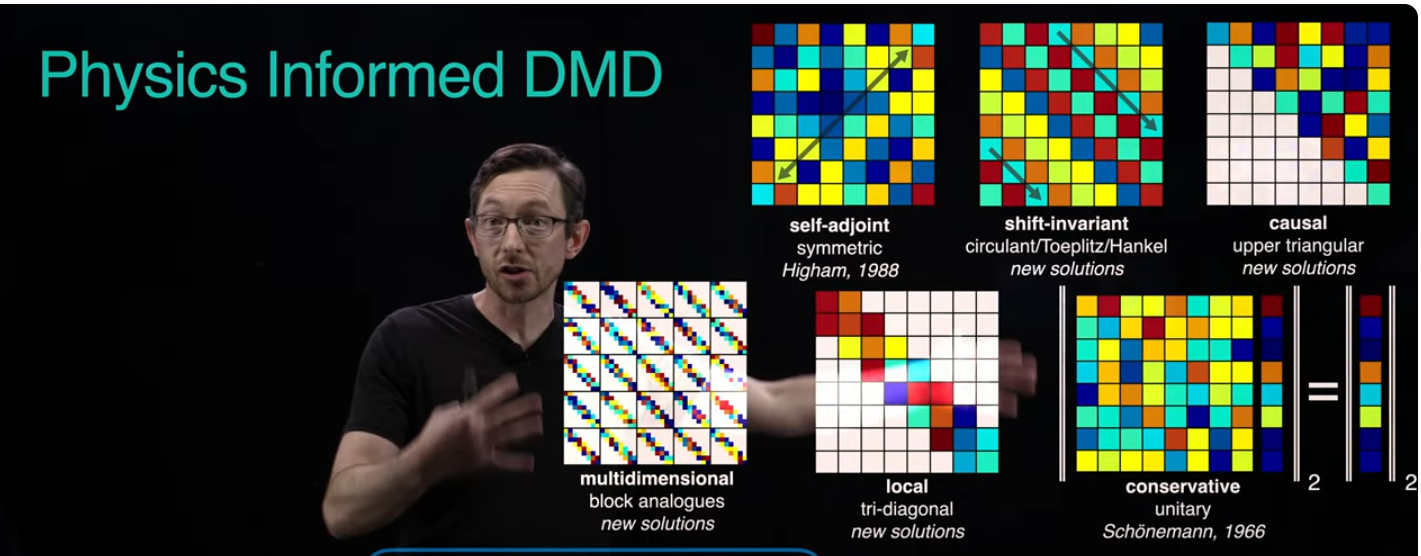

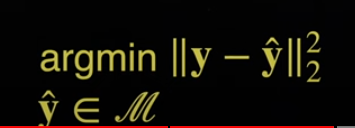

Enforce 對稱性:直接放在 optimization procedure (類似 chain of thought?)中: KKT condition, 上述矩陣對稱保持。直接限制 y_hat 要在 manifold 上。這是 constrained optimization!

-

Discovery 對稱性:反過來可以用 ML/AI 發現對稱性。