Source

AI 寫論文完全指南 (how to prompt) https://www.youtube.com/watch?v=rLpzqZXWK7g&ab_channel=%E8%A3%B9%E5%B0%8F%E8%84%9A%E7%9A%84%E5%A4%A7%E5%8F%94

AI 論文速通 (good tool introduction): https://www.youtube.com/watch?v=ltryguAwBZY&t=167s&ab_channel=pingfan

先明確本文 (AI for Paper) 是用 LLM 協助撰寫論文。不是直接交給 LLM 寫文章! 用 LLM 寫文章是放在 [[2024-08-15-AI_Scientist|AI Scientist]].

Why

爲什麽想用大語言模型(LLM)協助撰寫論文?因爲有需求。

- 學校畢業論文

- 教職申請或升等

- 增加學術聲望

What

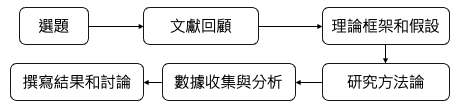

- 大多數論文都遵循特定的結構,使得 LLM 非常適合參與其中。

- 論文的文字雖然是簡單明瞭,但邏輯需要清晰,這可能是 LLM 的弱點。

LLM 可以協助這個過程的許多方面,包括:

- 選題:通過分析大量文獻和資料,生成具有關聯性的文獻回顧內容,幫助研究者找到研究的缺口和方向。

- 文獻綜述:快速瀏覽大量文獻並提取提取關鍵信息,幫助快速掌握研究領域的最新進展。

- 研究方法:提出研究問題、制定研究假設、選擇研究方法等。

- 數據分析:清理和預處理研究數據,統計分析數據,並生成圖表和表格等可視化結果。

- 撰寫初稿,修改和完善論文:生成摘要、引言、文獻綜述、結果、結論和貢獻。

AI 最有可能協助的是選題、文獻綜述和撰寫初稿。

How

What 部分提到的是論文的過程。接下來是 LLM 可以協助的部分。 特別是論文結構。一般論文的結構如下:

- 摘要 (abstract): 介紹研究的目的、結果和結論。

- 導言(Introduction):

- 背景介紹:引出研究主題,說明研究的動機和重要性。

- 問題陳述:明確指出研究的問題或目標。

- 文獻綜述回顧 (literature or prior survey):概述並總結先前相關文獻和研究,指出研究的缺口或不足之處。

- 方法(Methods):

- 研究設計:描述研究的整體設計和方法。

- 樣本/受試者:說明研究對象的選取標準和樣本量。

- 測量工具 or benchmark:介紹使用的測量工具、問卷或實驗設備。

- 數據分析:描述數據收集和分析的方法,包括統計方法。

- 結果(Results):

- 數據呈現:以圖表、表格或描述方式呈現研究結果。

- 統計分析:對數據進行統計分析,並分析結果。

- 討論(Discussion):

- 結果解釋:解釋研究結果並探討其含義,討論與文獻回顧的一致性或差異性。

- 問題分析:分析研究中遇到的問題或挑戰。可能的偏差和 ablation study

- 結論(Conclusion):

- 主要結論:總結研究的主要發現和對該領域的貢獻。

- 展望未來:提出未來研究的方向或建議。

- 參考文獻(References):

- 引用文獻:列出研究中引用的文獻或資料來源。

可用 AI 工具

文獻搜尋、回顧、綜述

- Search: Google Scholar https://scholar.google.com.tw/schhp?hl=en&as_sdt=0,5

- Link: connected papers https://www.connectedpapers.com/

- Semantic Scholar: https://www.semanticscholar.org/

文獻論文速讀,精讀

- 適合速讀:Clarity: summary, translate of PDF, YouTube, …

- 適合精讀:Immersive translate PDF (左右),twitter (上下),google book。

Q&A 筆記選題

- GPT3.5/4,marp (markdown to powerpoint or pdf)。這是 VS code 的 plug-in.

Coze

寫作輔助工具

- Notion, Dylai

- Jasper.ai: 是一個專門為學術研究人員設計的 LLM 寫作工具,可以提供文獻綜述、論文框架、初稿生成等功能。

修改和完善論文:

- Grammarly: Grammarly 是一款可以檢查文法、拼寫和語句結構的工具。

- QuillBot: QuillBot 是一款可以幫助重述和改寫句子的工具。

- Paraphrasely: Paraphrasely 是一款可以幫助生成文章不同表達方式的工具。

實例:白內障和帶眼鏡的相關性研究

為了進一步探討 LLM 在論文撰寫方面的應用潛力,我們以 “白內障和帶眼鏡的相關行研究” 為例,展示 LLM 如何協助研究人員完成論文撰寫。

研究主題: 白內障和帶眼鏡的關係

研究問題: 白內障患者是否更傾向於佩戴眼鏡?

數據來源: PubMed 醫學文獻資料庫

實例:使用LLM撰寫論文的簡介部分

引言(Introduction)

随着人工智能技术的飞速发展,大語言模型(LLM)在各个领域的应用日益广泛。本研究旨在探讨LLM在撰写論文方面的应用潜力和效果。通过对现有文献的综述,我们发现虽然LLM已经在文本生成、自然语言处理等方面取得了显著进展,但在撰写专业性强、结构复杂的論文方面还存在一定的挑战。因此,本研究旨在开发一种基于LLM的論文自动生成系统,以提高論文的撰写效率和质量。

本研究的主要目的是:(1)构建一个能够理解和生成論文结构的LLM模型;(2)开发一个用户界面友好的系统,允许研究者通过简单的输入和交互来生成論文;(3)评估系统的性能和效果,包括生成文章的质量、效率和用户满意度等方面。

本研究对于提高論文的撰写效率和质量具有重要意义。通过自动化生成論文的部分内容,研究者可以节省大量时间和精力,从而更加专注于研究本身。此外,本研究还可以为其他领域的文本生成任务提供有益的参考和借鉴。

在文献综述部分,我们将详细介绍现有关于LLM在文本生成方面的研究,以及論文撰写的一般流程和要求。通过对比和分析现有研究的优点和不足,我们将提出本研究的创新点和改进方向。

EPIM: Efficient Processing-In-Memory Accelerators based …

](https://arxiv.org/abs/2311.07620)

这份文件是一篇关于在处理内存(Processing-In-Memory, PIM)加速器上使用高效神经网络的学术论文,标题为“EPIM: Efficient Processing-In-Memory Accelerators based on Epitome”。以下是该论文的核心内容概述:

作者和机构:

- 作者包括来自清华大学、加州大学伯克利分校和字节跳动的研究人员。

- 论文的通讯作者为Zhen Dong、Daquan Zhou和Yu Wang。

摘要:

- 论文提出了一种名为EPIM的方法,旨在解决大规模神经网络在PIM加速器上部署时遇到的挑战,特别是受限于芯片上内存容量的问题。

- 通过引入一种名为Epitome的轻量级神经算子,该算子提供了类似卷积的功能,用于创建更高效的CNN算子。

- 软件方面,评估了Epitome在PIM加速器上的延迟和能耗,并引入了PIM感知的逐层设计方法来提高硬件效率。

- 硬件方面,修改了现有PIM加速器的数据路径以适应Epitome,并实现了一种称为“Channel Wrapping”的特征图重用技术来降低计算成本。

引言:

- PIM加速器通过在内存内部直接进行计算来提高神经网络操作的计算效率,但写入新兴内存的成本比读取高,限制了其性能。

相关工作:

- 论文回顾了PIM架构、Epitome和量化方法的相关研究。

框架概述:

- 描述了使用Epitome设计和训练神经网络的一般框架。

EPIM设计方法:

- 介绍了如何在PIM加速器上映射和调整Epitome。

- 提出了一种针对Epitome的量化方法。

- 描述了EPIM的架构和数据路径。

EPIM设计优化:

- 通过模拟评估了计算开销,并提出了逐层Epitome设计和输出通道包装来优化性能。

实验:

- 使用基于MNSIM的模拟器进行了实验,展示了EPIM方法在ImageNet数据集上的性能。

结果与分析:

- EPIM在保持高准确率的同时显著减少了交叉阵列的面积和推理能耗。

结论:

- EPIM方法通过使用3位量化的EPIM-ResNet50在ImageNet上达到了71.59%的top-1准确率,同时将交叉阵列面积减少了30.65倍。

参考文献:

- 论文列出了相关的参考文献,涵盖了PIM架构、神经网络压缩、量化方法等领域的研究。

这篇论文主要贡献在于提出了一种新的神经网络算子Epitome,并展示了如何将其应用于PIM加速器以提高效率和性能。